@ilyasuthttps://www.linkedin.com/in/ilya-sutskever

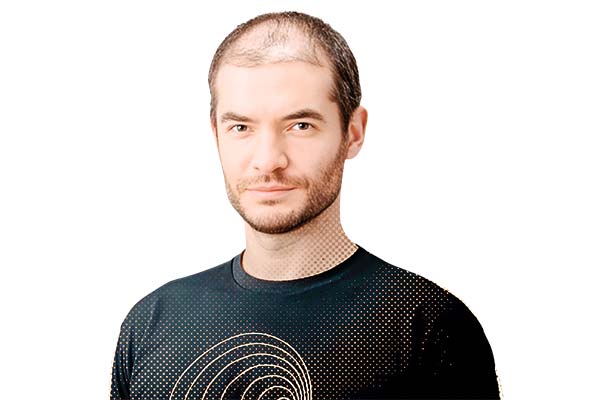

Es el cofundador de OpenAI, dirigió la investigación en la compañía creadora del ChatGPT y es uno de los arquitectos de los modelos GPT.

Antes de OpenAI, Ilya Sutskever fue coinventor de AlexNet y Sequence to Sequence Learning. Obtuvo su doctorado en Ciencias de la Computación en la Universidad de Toronto. Hoy está en los titulares porque decidió lanzar una nueva apuesta en Inteligencia Artificial.

Ilya Sutskever anunció esta semana a través de la red social X -ex Twitter- la creación de una nueva compañía de inteligencia artificial, Safe Superintelligence (SSI), que busca nada más y nada menos, perseguir una superinteligencia segura. En mayo había comunicado su salida de OpenAI.

La nueva compañía estará en Estados Unidos, pero con oficinas repartidas entre Palo Alto (California) y Tel Aviv (Israel).

Su paso por OpenAI

La historia de Ilya Sutskever se vuelve más interesante cuando revisamos sus acciones. Tuvo un papel clave en la crisis de OpenAI, que significó la salida y el regreso de su CEO Sam Altman.

En ese episodio, Sutskever estuvo en el bando de los miembros del directorio que intentaron destituir Altman. De hecho, varios medios publicaron que el científico había antagonizado con Altman porque consideraba que había embarcado a OpenAI en una carrera enfocada en el negocio, desentendiéndose de los peligros asociados al rápido desarrollo de la IA.

Sin embargo, a los pocos días del despido de Altman, cambió de bando y pidió perdón. En ese momento, varios consideraron que la convivencia de ambos en OpenAI sería complicada y que era cosa de tiempo su salida.

Y ese momento llegó en mayo. Sutskever anunció su salida de OpenAI. Ese mismo día Altman publicó en X lo siguiente: "Ilya y OpenAI se separarán. Esto es muy triste para mí; Ilya es fácilmente una de las mentes más brillantes de nuestra generación, una luz guía en nuestro campo y un querido amigo. Su brillantez y visión son bien conocidas; su calidez y compasión son menos conocidas pero no menos importantes. OpenAI no sería lo que es sin él".

Su nuevo proyecto

Ilya Sutskever ahora está embarcado en un nuevo proyecto. Junto con Daniel Levy, antiguo empleado de OpenAI, y Daniel Gross, inversionista, exsocio de Y Combinator, la incubadora de Silicon Valley que dirigía Altman, crearon SSI.

¿Qué busca Sutskever con SSI? su obsesión siempre ha sido crear una superinteligencia segura y al parecer ya algo ha avanzado en ese objetivo. Ha señalado que "en el nivel más básico, una superinteligencia segura debería tener la propiedad de no dañar a la humanidad a gran escala".

Asimismo, Sutskever le dijo a Bloomberg que el primer producto de SSI será una superinteligencia, una tecnología aún inexistente en la actualidad, asegurada, y que la empresa no se dedicará a nada más hasta su creación.

Agregó que la nueva firma estará blindada de las presiones externas relacionadas con la gestión de productos complejos y de ser atrapada en una carrera competitiva.

Instagram

Instagram Facebook

Facebook LinkedIn

LinkedIn YouTube

YouTube TikTok

TikTok