El dilema entre robots y humanos según César Hidalgo

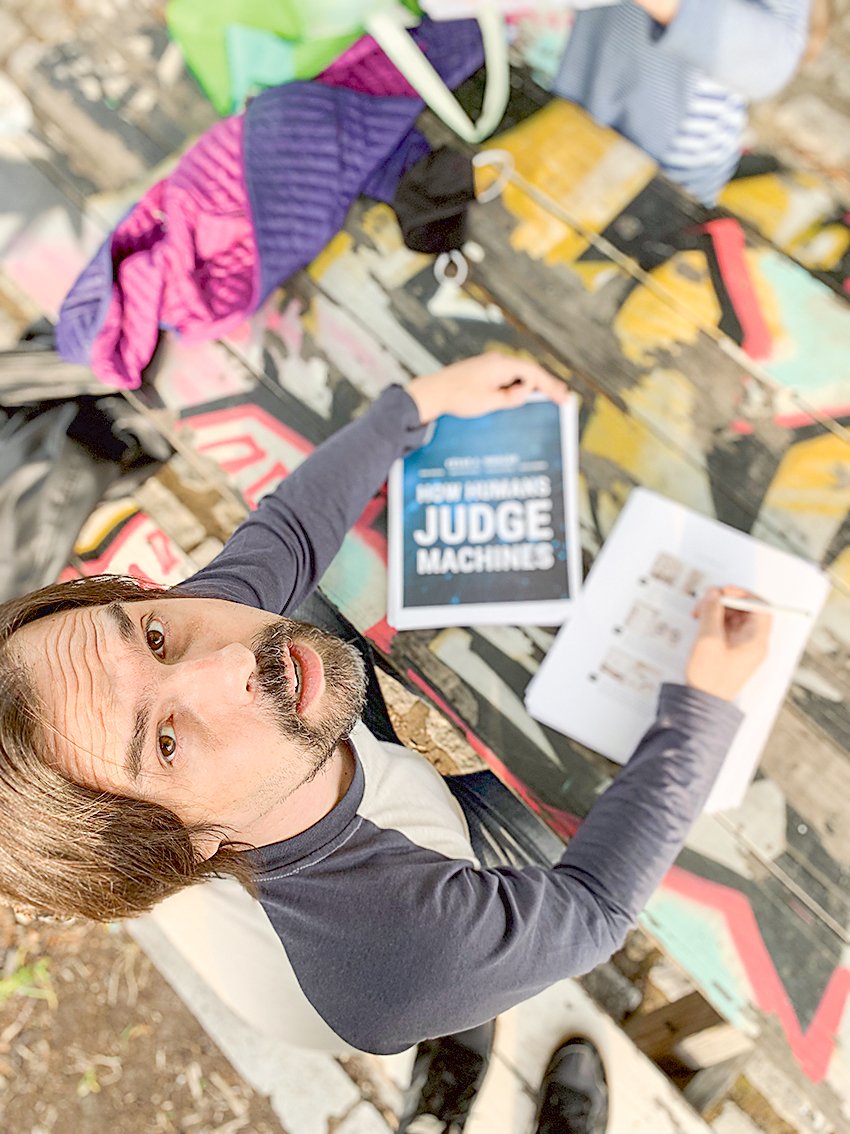

El físico acaba de publicar How humans judge machines. Para hacerlo, simuló más de 80 escenarios y los testeó en 6 mil personas en EEUU.

- T+

- T-

Son las 4 del miércoles. Al otro lado del Meet, el físico chileno César Hidalgo (40) se balancea en una silla en su casa en Boston, al tiempo que se mueve el pelo una y otra vez. De fondo se ve un estante con libros y objetos de decoración y una guitarra eléctrica.

Le pregunto por el debate que la noche anterior enfrentó a Donald Trump con Joe Biden. “Para nosotros (con su mujer de nacionalidad rusa) es como ver una película porque no es como yo creo que se debería asignar la cantidad de poder en democracia. Encontré que a Biden le costaba articular las frases, sobre todo al principio. Y Trump, aunque habló muy asertivo para su base, dijo cosas muy feas. Cuando se están pegando tan bajo, la gente acá igual tiene un sentido ético en el que la forma importa... Pero no quiero hablar de esto. Pasé tres años escribiendo un libro, no para estar opinando ahora de cosas que no he investigado. ¿Me cachai?”

Cierto. Aunque más adelante hablará de política en Chile y Estados Unidos, el motivo de la entrevista es el lanzamiento de How humans judge machines, el tercero que el titular de la cátedra ANITI en la Universidad de Toulouse y experto en Big Data, lanza. Y lo hizo gratis en la web (www.judgingmachines.com)

-¿Por qué gratis?

-Porque me interesa que el libro se lea, se use, se cite y que si hay un profe en un país que no tiene acceso al impreso por logística o finanzas, pueda leerlo. La edición papel estará disponible en febrero.

En 251 páginas, el chileno que trabajó por casi 10 años en el MIT plantea 86 escenarios donde una misma acción la lleva a cabo una persona y un robot, y analiza cómo el resultado es interpretado por las personas. Para eso experimentó con 6 mil voluntarios a través de la plataforma Amazon Mechanical Turk.

Sobre el libro, el economista Daron Acemoglu escribió: “Una lectura obligada para todos los que deseen comprender el futuro de la IA en nuestra sociedad”, y el Nobel Paul Romer, dijo: “Evidencia, no mera conjetura o anécdota, sobre juicios morales humanos”.

Hidalgo cuenta que la idea surgió porque la literatura existente sobre Inteligencia Artificial (IA), hasta entonces solo abordaba sus implicancias sociales. “Me parecía peligroso porque la tecnología estaba siendo evaluada como que si no era perfecta estaba equivocada, cuando en realidad el humano tampoco es perfecto”, asegura.

Con ese objetivo, en 2017 encargó a dos postdoctoradas en sicología social del MIT, construir las preguntas y escenarios posibles tomando las dimensiones morales de Jonathan Haidt: daño, justicia, lealtad, autoridad y pureza. A eso le agregó otros componentes: que los problemas tuvieran sesgos algorítmicos, o temas vinculados a privacidad y automatización de trabajo. Algunos ejemplos que plantea son: un auto conducido por una persona/máquina atropella a una persona en un cruce; o en un tsunami, una persona/máquina intenta rescatar al 100% de las personas, con posibilidad de que todos mueran o todos se salven; o intenta rescatar solo al 50%, con total posibilidad de éxito.

En grupos de 200 personas que respondieron 10 preguntas cada uno, considerando solamente la opción “humano” o la opción “máquina”, y luego esas respuestas se contrastaron con las de otro grupo que solo respondió el escenario contrario. Con los resultados analizados Hidalgo envió dos versiones a MIT Press para revisión. En abril debía estar listo el libro. Pero el covid lo postergó hasta el 29 de septiembre.

La principal conclusión de la investigación es que las personas juzgan diferente a los seres humanos y las máquinas: cuando hay accidentes justifican más a la personas que a la tecnología. Y en los primeros calibran la intención con el resultado, mientras que a los robots, solamente se le miden los resultados. “A las máquinas las juzgamos fuerte y muy mal sobre todo en escenarios que no tienen consecuencias muy graves. Un ejemplo ilustrativo es el de la retroexcavadora que por casualidad exhuma una tumba. En ese caso, que es accidental, pese que no hay daño, las personas tienden a ser muy poco pacientes con las máquinas”, explica Hidalgo.

-¿Qué implicancias tienen los resultados?

-Hay varias aplicaciones: una es que si estás en el negocio de diseñar tecnología, en vez de hacer una que optimice su capacidad, vas a verte forzado a diseñar una que minimice su exposición a una opinión pública negativa o a los errores. Pese a que si ésta tomara decisiones en un ambiente de incertidumbre podría tener un mejor resultado, la jugada segura -incluso cuando eso pueda tener un costo mayor a la sociedad- tiene menos riesgo de ser rechazada. Al humano le conviene tomar el riesgo porque si lo hace lo evalúan bien, pero a la máquina no.

-¿Esto se aplica a cualquier industria?

-Se aplica a todas las industrias pero no por igual. Creo que los casos más interesantes para tus lectores están en el capítulo 6 sobre automatización y trabajo. En ese caso comparamos cómo la gente evalúa a las máquinas en comparación a personas extranjeras que vienen a tomar trabajos. Encontramos que las personas tienden a reaccionar de manera más negativa frente a extranjeros reemplazándolos -sobre todo en trabajos blue collar (camioneros, por ejemplo). En temas de privacidad, también hay diferencias por industria: en un colegio, las personas no quieren que las máquinas observen a los niños, prefieren a humanos. Pero en un aeropuerto, quieren que sean cámaras y no militares los que los observen.

-Si llevamos la privacidad al covid: hay países que han implementado televigilancia para controlar la pandemia. ¿Qué pasa en ese caso?

-No lo puedo extrapolar porque eso es chamullo.

Democracia de broadcasting

A medida que la conversación avanza, Hidalgo reflexiona sobre el momento actual. Cree que los problemas que estamos viviendo tanto en Chile como EEUU -que se expresan en un sistema político polarizado- son síntomas de quiebres más profundos, tanto en la manera de gobernarnos de manera colectiva, como de la tecnología que estamos usando.

“Todavía tenemos una democracia de imprenta, muy de broadcasting, muy episódica donde eliges a una persona cada 4 años. Por otro lado, en las últimas tres décadas han emergido grandes plataformas (como la web) y agregadores (como Facebook o Amazon), que han generado sistemas muy centralizados para almacenar información y administrarla, y que es muy valiosa para los usuarios. Hoy la identidad digital es cada vez más importante y poderosa porque es nuestro acceso al banco, a la comunicación personal, bitácoras de vida... y tenemos toda esa gran cantidad de poder que emerge no de la cantidad de datos si no de la centralización de ellos. En ese contexto hemos sido capaces de desarrollar aplicaciones de IA con grandes asimetrías de poder, mientras el gobierno sigue a papel”, explica.

-¿Cuál es tu propuesta para salir de ahí?

-Lo que se viene es cómo hacer una transición a formas de poder descentralizadas tanto en el mundo del papel que rige en nuestros gobiernos, en nuestras entidades de pasaporte, como en el mundo digital, donde nuestra identidad está validada por sitios como Google, Facebook, Twitter y LinkedIn. El hecho de que estemos lejos de eso es lo que nos tiene con muchos problemas, tanto en el sector público, donde nos jugamos todo cada 4 años en una elección -si alguien propusiera la democracia que tenemos hoy como una idea nueva, yo creo que todo el mundo la rechazaría-, como en el sistema centralizado de los medios online que tiene una influencia muy grande sobre las personas. Y descentralizarla va a incluir llevar la IA al borde de la red, no al centro.

-Ahí viene el link con tu libro...

-Claro, el libro trata de entender cómo la gente percibe la tecnología porque solo va a ser posible hacer estos cambios si las personas son capaces de aceptar innovaciones tecnológicas que ayuden a mejorar las cosas. Si la gente rechaza esos cambios o la posibilidad de usar tecnología en algunos de estos espacios vamos a quedarnos atrapados en lo que estamos ahora.

Te puede interesar: Habla Jeff Orlowski, director de El dilema de las redes sociales: "Facebook nos robó la palabra amigo"

Ateo x 3

Hidalgo se define como “triplemente ateo: de religión, de política y de nacionalidad”. Dejó Chile en 2003, y sólo tuvo la oportunidad de votar una vez (Lavín-Lagos). No lo hizo. Después nunca más pudo hacerlo porque no se podía votar desde el extranjero. Ahora no votará. “Por ser migrante, ya fui excluido de la democracia. Porque los países no están hechos para personas que migran, sino para quienes nacen y mueren en ese lugar. La gente no sabe, por ejemplo, que trabajar es ilegal”, asegura.

-¿Trabajar?

-Porque te vas a cualquier país y tienes que pedir permiso para trabajar con alguien más y que te paguen. No es un derecho humano, es un privilegio. ¡Eso es lo mas explotador que hay! Por que si yo y tú queremos escribir algo juntos y vendérselo a alguien que quiere comprarlo de su propia voluntad le tenemos que pedir permiso a un señor feudal, lo que me parece absolutamente ridículo.

La última vez que puso un pie en Santiago fue en agosto del año pasado. Y aunque dice que “este es un Chile que no conozco” y del que preferiría no opinar, el octubre de 2019, tras el estallido social no dudó en enviar un video a través de sus redes sociales al Presidente Piñera donde, desde Harvard, lo llamó a “recapacitar”.

-¿A tu juicio el Presidente recapacitó?

-Yo lo que quiero es que la gente en Chile se quiera y se lleve bien. Veo el odio que hay, la manera en que las personas pelean unas con otras. Esto no nos está llevando a nada. No quiero que gane un lado u otro.

-¿Este plebiscito va en la línea de lograr acuerdos?

-Las personas que van a votar en esta elección eran bebés de un año cuando me fui del país. Es un problema en el que Chile se metió y tiene que salir. La última vez que estuve allá hice un post en Facebook sobre esta división que hay, que a uno se le olvida, entre los cuicos y los flaites, en la política, y en distintos mundos donde la gente se estereotipa tanto. Lo sentí y me da pena.

-Por eso, tu decisión de ser un outsider...

-Puede ser. Yo siento que es una ridiculez como se administra este mundo. Si hay marcianos y nos ven, se van a cagar de la risa.